¿Qué es

la robótica? (Concepto)

Técnica que se utiliza en el diseño y la construcción de robots y aparatos que realizan operaciones o trabajos, generalmente en

instalaciones industriales y en sustitución de la mano de obra humana.

Aunado a esto la robótica también se puede definir como una disciplina

que se compone se una gran variedad de ciencias tales como la ingeniería mecánica, ingeniería eléctrica,

ingeniería electrónica y ciencias de la computación que en conjunto se encargan

de la construcción, diseño, operación, disposición estructural, manufactura y

su aplicación en los robots.

Robótica. (Contexto histórico)

La robótica tiene una estricta relación con la construcción

de artefactos debido a los remotos de deseos de los humanos de construir seres

a su semejanza facilitando la labor de las personas El ingeniero español

Leonardo Torres Quevedo (que construyó el primer mando a distancia para su

automóvil mediante telegrafía sin hilo (El primer ajedrez ¨automático¨)

Robótica. (Leyes de la robótica)

Karel Čapek, un escritor checo, acuñó en 1921 el término

"Robot" en su obra dramática Rossum's Universal Robots / R.U.R., a

partir de la palabra checa robota, que significa servidumbre o trabajo forzado.

El término robótica es acuñado por Isaac Asimov, definiendo a la ciencia que

estudia a los robots. Asimov creó también las Tres Leyes de la Robótica. En la

ciencia ficción el hombre ha imaginado a los robots visitando nuevos mundos,

haciéndose con el poder, o simplemente aliviando de las labores caseras.

1.-Un robot no hará daño a un ser humano o, por inacción, permitir que un ser humano sufra daño.

2.-Un robot debe obedecer las órdenes dadas por los seres humanos, excepto si estas órdenes entrasen en conflicto con la 1ª Ley.

3.-Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la 1ª o la 2ª Ley.1

Estas 3 leyes surgen como medida de protección para los seres humanos según el propio Asimov la concepción de las leyes de la robótica para contrarrestar un supuesto complejo de Frankenstein es decir un temor que el ser humano desarrollaría de que unas maquinas pudieran rebelarse o alzarse contra sus creadores.

Robótica. (Clasificación)

Existen muchas maneras de clasificar a los robot pero las más comunes son las siguientes:

Por cronología:

1.ª Generación.

Manipuladores. Son sistemas mecánicos multifuncionales con un sencillo sistema de control, bien manual, de secuencia fija o de secuencia variable.

2.ª Generación.

Robots de aprendizaje. Repiten una secuencia de movimientos que ha sido ejecutada previamente por un operador humano. El modo de hacerlo es a través de un dispositivo mecánico. El operador realiza los movimientos requeridos mientras el robot le sigue y los memoriza.

3.ª Generación.

Robots con control sensorizado. El controlador es una computadora que ejecuta las órdenes de un programa y las envía al manipulador para que realice los movimientos necesarios.

4.ª Generación.

Robots inteligentes. Son similares a los anteriores, pero además poseen sensores que envían información a la computadora de control sobre el estado del proceso. Esto permite una toma inteligente de decisiones y el control del proceso en tiempo real.

1.-Un robot no hará daño a un ser humano o, por inacción, permitir que un ser humano sufra daño.

2.-Un robot debe obedecer las órdenes dadas por los seres humanos, excepto si estas órdenes entrasen en conflicto con la 1ª Ley.

3.-Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la 1ª o la 2ª Ley.1

Estas 3 leyes surgen como medida de protección para los seres humanos según el propio Asimov la concepción de las leyes de la robótica para contrarrestar un supuesto complejo de Frankenstein es decir un temor que el ser humano desarrollaría de que unas maquinas pudieran rebelarse o alzarse contra sus creadores.

Robótica. (Clasificación)

Existen muchas maneras de clasificar a los robot pero las más comunes son las siguientes:

Por cronología:

1.ª Generación.

Manipuladores. Son sistemas mecánicos multifuncionales con un sencillo sistema de control, bien manual, de secuencia fija o de secuencia variable.

2.ª Generación.

Robots de aprendizaje. Repiten una secuencia de movimientos que ha sido ejecutada previamente por un operador humano. El modo de hacerlo es a través de un dispositivo mecánico. El operador realiza los movimientos requeridos mientras el robot le sigue y los memoriza.

3.ª Generación.

Robots con control sensorizado. El controlador es una computadora que ejecuta las órdenes de un programa y las envía al manipulador para que realice los movimientos necesarios.

4.ª Generación.

Robots inteligentes. Son similares a los anteriores, pero además poseen sensores que envían información a la computadora de control sobre el estado del proceso. Esto permite una toma inteligente de decisiones y el control del proceso en tiempo real.

Otra clasificación

podría ser la fisiológica que como el nombre lo indica se basa en las características

físicas y en cierta parte en el comportamiento de estos robots.

1. Poliarticulados

En

este grupo se encuentran los Robots de muy diversa forma y configuración, cuya

característica común es la de ser básicamente sedentarios (aunque

excepcionalmente pueden ser guiados para efectuar desplazamientos limitados) y

estar estructurados para mover sus elementos terminales en un determinado

espacio de trabajo según uno o más sistemas de coordenadas, y con un número

limitado de grados de libertad.

2. Móviles Son

Robots con gran capacidad de desplazamiento, basada en carros o plataformas y

dotada de un sistema locomotor de tipo rodante. Siguen su camino por telemando

o guiándose por la información recibida de su entorno a través de sus sensores.

Estos Robots aseguran el transporte de piezas de un punto a otro de una cadena

de fabricación.

3. Androides

Son Robots que intentan reproducir total o parcialmente la forma y el comportamiento cinemático del ser humano. Actualmente, los androides son todavía dispositivos muy poco evolucionados y sin utilidad práctica, y destinados, fundamentalmente, al estudio y experimentación. Uno de los aspectos más complejos de estos Robots, y sobre el que se centra la mayoría de los trabajos, es el de la locomoción bípeda. En este caso, el principal problema es controlar dinámica y coordinadamente en el tiempo real el proceso y mantener simultáneamente el equilibrio del Robot.

Son Robots que intentan reproducir total o parcialmente la forma y el comportamiento cinemático del ser humano. Actualmente, los androides son todavía dispositivos muy poco evolucionados y sin utilidad práctica, y destinados, fundamentalmente, al estudio y experimentación. Uno de los aspectos más complejos de estos Robots, y sobre el que se centra la mayoría de los trabajos, es el de la locomoción bípeda. En este caso, el principal problema es controlar dinámica y coordinadamente en el tiempo real el proceso y mantener simultáneamente el equilibrio del Robot.

4. Zoomórficos

Los Robots zoomórficos, que considerados en sentido no restrictivo podrían incluir también a los androides, constituyen una clase caracterizada principalmente por sus sistemas de locomoción que imitan a los diversos seres vivos. A pesar de la disparidad morfológica de sus posibles sistemas de locomoción es conveniente agrupar a los Robots zoomórficos en dos categorías principales: caminadores y no caminadores. El grupo de los Robots zoomórficos no caminadores está muy poco evolucionado. Las aplicaciones de estos Robots serán interesantes en el campo de la exploración espacial y en el estudio de los volcanes.

Los Robots zoomórficos, que considerados en sentido no restrictivo podrían incluir también a los androides, constituyen una clase caracterizada principalmente por sus sistemas de locomoción que imitan a los diversos seres vivos. A pesar de la disparidad morfológica de sus posibles sistemas de locomoción es conveniente agrupar a los Robots zoomórficos en dos categorías principales: caminadores y no caminadores. El grupo de los Robots zoomórficos no caminadores está muy poco evolucionado. Las aplicaciones de estos Robots serán interesantes en el campo de la exploración espacial y en el estudio de los volcanes.

5. Híbridos

Corresponden a aquellos de difícil clasificación, cuya estructura se sitúa en combinación con alguna de las anteriores ya expuestas, bien sea por unión de complementos físicos o de los comportamientos que caracterizan a los robots de algunas categorias. Por ejemplo, un dispositivo segmentado articulado y con ruedas, es al mismo tiempo, uno de los atributos de los Robots móviles y de los Robots zoomórficos.

Corresponden a aquellos de difícil clasificación, cuya estructura se sitúa en combinación con alguna de las anteriores ya expuestas, bien sea por unión de complementos físicos o de los comportamientos que caracterizan a los robots de algunas categorias. Por ejemplo, un dispositivo segmentado articulado y con ruedas, es al mismo tiempo, uno de los atributos de los Robots móviles y de los Robots zoomórficos.

REDES NEURONALES.

En esta parte del documento hablaremos sobre las redes

neuronales (artificiales) pero para comprender mejor esto debemos ver primero

el sistema de una red neuronal biológica.

Red neuronal biológica. (concepto)

No es más que el medio de ¨transferencia¨ de un seres humano a través del cual envía neuronas

de su cerebro a otras partes de su cuerpo en forma de impulsos eléctricos para

dar órdenes a dicha sección donde se enviaron dichas neuronas.

Red neuronal artificial. (Concepto)

Es la forma de imitación de un sistema de red neuronal biológico

aplicado en electrónicos y referido a la sección anterior de robótica principalmente

en robots de tipo zoomórficos, androides e híbridos.

Red neuronal artificial. (Historia)

Los primeros modelos de redes neuronales datan de 1943 por

los neurólogos Warren McCulloch y Walter Pitts. Años más tarde, en 1949, Donald

Hebb desarrolló sus ideas sobre el aprendizaje neuronal, quedando reflejado en

la "regla de Hebb". En 1958, Rosenblatt desarrolló el perceptrón

simple, y en 1960, Widrow y Hoff desarrollaron el ADALINE, que fue la primera

aplicación industrial real.

En los años siguientes, se redujo la investigación, debido a

la falta de modelos de aprendizaje y el estudio de Minsky y Papert sobre las

limitaciones del perceptor. Sin embargo, en los años 80, volvieron a resurgir

las RNA gracias al desarrollo de la red de Hopfield, y en especial, al

algoritmo de aprendizaje de retro propagación (Back Propagation) ideado por

Rumelhart y McClelland en 1986 que fue aplicado en el desarrollo de los perceptores

multicapa.

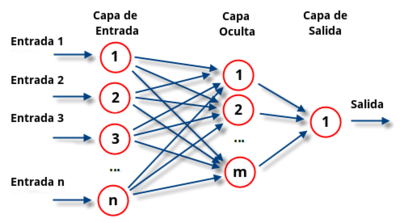

Red neuronal. (Características)

Una red neuronal se compone de unidades llamadas neuronas.

Cada neurona recibe una serie de entradas a través de interconexiones y emite

una salida. Esta salida viene dada por tres funciones:

1.- Una función de propagación (también conocida como función

de excitación), que por lo general consiste en el sumatorio de cada entrada

multiplicada por el peso de su interconexión (valor neto). Si el peso es

positivo, la conexión se denomina ex citatoria; si es negativo, se denomina

inhibitoria.

2.- Una función de activación, que modifica a la anterior.

Puede no existir, siendo en este caso la salida la misma función de propagación.

3.- Una función de

transferencia, que se aplica al valor devuelto por la función de activación. Se

utiliza para acotar la salida de la neurona y generalmente viene dada por la

interpretación que queramos darle a dichas salidas. Algunas de las más utilizadas

son la función sigmoidea (para obtener valores en el intervalo (0,1)) y la

tangente hiperbólica (para obtener valores en el intervalo.

Red neuronal. (Estructura)

La mayoría de los científicos coinciden en que una

RNA es muy diferente en términos de estructura de un cerebro animal. Al igual

que el cerebro, una RNA se compone de un conjunto masivamente paralelo de

unidades de proceso muy simples y es en las conexiones entre estas unidades

donde reside la inteligencia de la red. Sin embargo, en términos de

escala, un cerebro es muchísimo mayor que cualquier RNA creada hasta la

actualidad, y las neuronas artificiales también son más simples que su

contrapartida animal.

Biológicamente, un cerebro aprende mediante la

reorganización de las conexiones sinápticas entre las neuronas que

lo componen. De la misma manera, las RNA tienen un gran número de procesadores virtuales

interconectados que de forma simplificada simulan la funcionalidad de las

neuronas biológicas. En esta simulación, la reorganización de las conexiones

sinápticas biológicas se modela mediante un mecanismo de pesos, que son ajustados durante la

fase de aprendizaje. En una RNA entrenada, el conjunto de los pesos determina

el conocimiento de

esa RNA y tiene la propiedad de resolver el problema para el que la RNA ha sido

entrenada.

Red neuronal. (Ventajas)

Las redes neuronales artificiales (RNA) tienen muchas

ventajas debido a que están basadas en la estructura del sistema nervioso,

principalmente el cerebro.

Aprendizaje: Las RNA tienen la habilidad de aprender mediante

una etapa que se llama etapa de aprendizaje. Esta consiste en proporcionar a la

RNA datos como entrada a su vez que se le indica cuál es la salida (respuesta)

esperada.

Auto organización: Una RNA crea su propia representación de

la información en su interior, quitándole esta tarea al usuario.

Tolerancia a fallos: Debido a que una RNA almacena la

información de forma redundante, ésta puede seguir respondiendo de manera

aceptable aun si se daña parcialmente.

Flexibilidad: Una RNA puede manejar cambios no importantes en

la información de entrada, como señales con ruido u otros cambios en la entrada

(por ejemplo si la información de entrada es la imagen de un objeto, la

respuesta correspondiente no sufre cambios si la imagen cambia un poco su

brillo o el objeto cambia ligeramente).

Tiempo real: La estructura de una RNA es paralela, por lo

cual si esto es implementado con computadoras o en dispositivos electrónicos

especiales, se pueden obtener respuestas en tiempo real.

Inteligencia artificial.

La inteligencia artificial (IA) (concepto)

es un área

multidisciplinaria, que a través de ciencias como las ciencias de la

computación, la matemática, la lógica y la filosofía, estudia la creación y

diseño de sistemas capaces de resolver problemas cotidianos por sí mismos,

utilizando como paradigma la inteligencia humana. General y amplio como eso, reúne a amplios campos, los cuales tienen en

común la creación de máquinas capaces de pensar. En ciencias de la computación

se denomina inteligencia artificial a la capacidad de razonar de un agente no

vivo.1 2 3 John McCarthy acuñó la expresión «inteligencia artificial» en 1956,

y la definió así: “Es la ciencia e ingenio de hacer máquinas inteligentes,

especialmente programas de cómputo inteligentes” Al igual que en la informática

convencional, en la Inteligencia artificial tenemos una serie de elementos

peculiares que la caracterizan y la diferencian. Para Nilsson son cuatro los

pilares básicos en los que se apoya la Inteligencia Artificial, los cuales

serán analizados a continuación.

categorias de la (IA)

Búsqueda heurística. Podemos definir una heurística como un

truco o estrategia que limita grandiosamente la búsqueda de soluciones ante

grandes espacios de problemas. Por lo tanto ante un problema, nos ayuda a

seleccionar las bifurcaciones, dentro de un árbol, con más posibilidades, con

ello se restringe la búsqueda aunque no siempre se garantiza una solución

adecuada. Todo lo que se debe tener para que una heurística sea adecuada es que

nos proporcione soluciones que sean lo suficientemente buenas. Además utilizando

la heurística, no será necesario replantear un problema cada vez que se

afronte, ya que si lo hemos planteado anteriormente, ésta sugerirá la forma en

que se ha de proceder para resolverlo. Representación del conocimiento. La

representación es una cuestión clave a la hora de encontrar soluciones a los

problemas planteados, y que además éstas sean adecuadas. Si analizamos más

detenidamente el término y además dentro de la Informática, y más concretamente

dentro de la Inteligencia Artificial, encontramos varias definiciones, como

pueden ser las siguientes: según Barr y Feigenbaum, la representación del

conocimiento es una combinación de estructuras de datos y procedimientos de

interpretación que, si son utilizados correctamente por un programa, éste podrá

exhibir una conducta inteligente.

Inteligencia artificial (Historia)

El término “inteligencia artificial” fue acuñado formalmente

en 1956 durante la conferencia de Darthmounth, más para entonces ya se había

estado trabajando en ello durante cinco años en los cuales se había propuesto muchas

definiciones distintas que en ningún caso habían logrado ser aceptadas

totalmente por la comunidad investigadora. La IA es una de las disciplinas más

nuevas junto con la genética moderna.

Las ideas más básicas se remontan a los griegos, antes de Cristo.

Aristóteles (384-322 a. C.) fue el primero en describir un conjunto de reglas

que describen una parte del funcionamiento de la mente para obtener

conclusiones racionales, y Ctesibio de Alejandría (250 a. C.) construyó la

primera máquina autocontrolada, un regulador del flujo de agua (racional pero

sin razonamiento).

En 1315 Ramon Llull en su libro Ars magna tuvo la idea de que

el razonamiento podía ser efectuado de manera artificial.

En 1936 Alan Turing diseña formalmente una Máquina universal

que demuestra la viabilidad de un dispositivo físico para implementar cualquier

cómputo formalmente definido.

En 1943 Warren McCulloch y Walter Pitts presentaron su modelo

de neuronas artificiales, el cual se considera el primer trabajo del campo, aún

cuando todavía no existía el término. Los primeros avances importantes

comenzaron a principios del año 1950 con el trabajo de Alan Turing, a partir de

lo cual la ciencia ha pasado por diversas situaciones.

En 1955 Herbert Simon, Allen Newell y J.C. Shaw, desarrollan

el primer lenguaje de programación orientado a la resolución de problemas, el

IPL-11. Un año más tarde desarrollan el LogicTheorist, el cual era capaz de

demostrar teoremas matemáticos.

En 1956 fue inventado el término inteligencia artificial por

John McCarthy, Marvin Minsky y Claude Shannon en la Conferencia de Dartmouth,

un congreso en el que se hicieron previsiones triunfalistas a diez años que

jamás se cumplieron, lo que provocó el abandono casi total de las

investigaciones durante quince años.

En 1957 Newell y Simon continúan su trabajo con el desarrollo

del General Problem Solver (GPS). GPS era un sistema orientado a la resolución

de problemas.

En 1958 John McCarthy desarrolla en el Instituto de

Tecnología de Massachusetts (MIT) el LISP. Su nombre se deriva de LISt

Processor. LISP fue el primer lenguaje para procesamiento simbólico.

Investigadores de la inteligencia artificial.

Jeff Hawkins.

John McCarthy.

Marvin Minsky.

Judea Pearl.

Alan Turing, discípulo de John von Neumann, diseñó el Test de

Turing que debería utilizarse para comprender si una máquina lógica es

inteligente o no.

Joseph Weizenbaum.

Raúl Rojas.

Ray Kurzweil.

No hay comentarios:

Publicar un comentario